Klára Ponczová, 23. 02. 21

Hraním počítačové hry, ve které musí postavička, takzvaný “agent”, řízený strojovým učením sám před sebou skrývat a následně hledat předměty, se AI učí nejen to, jak v dané hře uspět, ale také, jak funguje svět. Metodou pokus-omyl a nahlížením na situace z různých úhlů, jsou pak “agenti” schopni sami vynalézat herní strategie vedoucí k úspěchu.

Většina vědců zabývajících se umělou inteligencí se nezabývá průkopnickými studiemi kognitivního vývoje dětí, se kterými v 50. letech přišel sociolog Jean Piaget. V vědci z Allenova institutu pro AI (AI2), kde se povedlo AI naučit jeden z Piagetových vývojových konceptů, konkrétně ten o trvalosti objektu.

Kde je maminka? Tady je!

Jde o porozumění tomu, že objekt skrytý před naším zrakem, stále existuje, i když jej zrovna nevidíme. U lidí se toto chápání rozvíjí postupně, proto se malé děti tolik radují, když si máma zakryje obličej rukama se slovy: “Kdepak je maminka?” A následně jej opět odkryje s radostným zvoláním: “Tady je!” “Znovuodhalení” maminky totiž pro dítě znamená něco jako její “znovuzrození”. Ještě vteřinu zpátky bylo totiž bytostně přesvědčené o tom, že mu maminka ze světa nadobro zmizela.

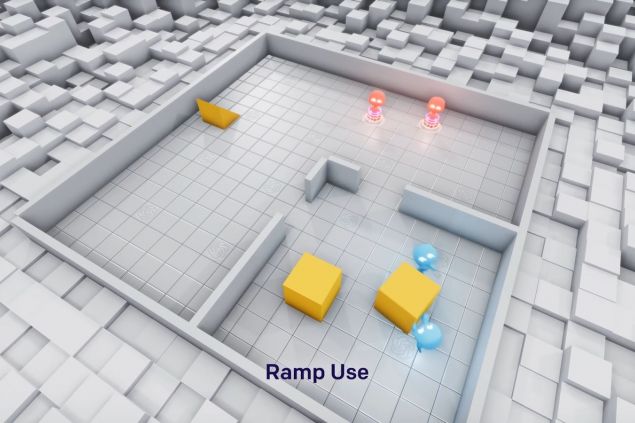

"Agenti" se ve hrách naučili nejen tomu, ale i mnoha dalším základním pravidlům fungování našeho světa. Hra na schovávanou, kterou vědci nazvali “Cache” neboli “Tajná skrýš”, se odehrávala v simulovaném, ale docela realistickém 3D domě. Tam museli “agenti” skrývat například záchodový zvon, rajčata, bochníky chleba, šálky nebo nože sami před sebou, přesněji řečeno před jinou verzí sebe samých.

Pokus-omyl

K řešení zadaných úkolů přitom používali metodu takzvaného strojového učení. 3D prostředí, o kterém na startu nic nevěděli, zpočátku prozkoumávali náhodnými akcemi metodou pokus-omyl. Zkoušeli tak například zatáhnout za šuplík nebo za nepohyblivou zeď a předměty, které měli za úkol schovat, umisťovali na zcela náhodná, nějak nepromyšlená místa.

K výraznému zlepšení došlo v okamžiku, kdy hráli proti jiné verzi sebe samých a učili se z výsledků - tedy pokud “hledající” nenašel rajče, pak ten, kdo ho schovával, věděl, že vymyslel dobrý úkryt.

Sám sobě učitelem

Tým AI2 pracuje mimo jiné i na takzvaném učení reprezentace, ve kterém jsou systémům AI poskytovány určité vstupy - obrázky, zvuk, text a podobně. Následně se AI učí kategorizovat data na základě jejich funkcí. Například v počítačovém vidění by se systém AI mohl naučit vždy rozeznat, který obrázek/zvuk/text představuje kočku nebo třeba semafor. V ideálním případě by se naučil také to, jak data kategorizovat, což znamená, že by pak zvládl vhodně zařadit i objekty, které nikdy předtím neviděl.

Když vědci začínali s metodou hlubokého učení, nejprve trénovali AI systémy v databázích oštítkovaných obrázků jako je slavný ImageNet. Protože štítky umožňují AI kontrolovat jeho práci, je tato technika nazývaná supervizovaným učením. Trend několika posledních let se však posouvá od supervizovaného učení k učení sebekontrolovanému, kde si AI systém musí štítky vytvářet sám.

Škola hrou

Tým AI2 věří, že právě tím, že nechají roboty v Cache si jen tak “hrát”, na všechno si přijdou sami.

V okamžiku, kdy se začalo “agentům” ve hře dařit, pak výzkumníci otestovali jejich porozumění světu. Na počítačově generovaných obrázcích pokojů po nich chtěli, aby odhadli, jakou má nějaký prostor hloubku a jaký je geometrický tvar určitých objektů.

Ve srovnání s modelem vyškoleným na ImageNetu, AI2 “agent” dosahoval stejných nebo lepších výsledků. Pokud mu byly předloženy fotky reálných pokojů, tak i přesto, že nedosáhl tak dobrých výsledků jako model trénovaný přímo na ImageNetu, dosáhl lepších výsledků, než jaké vědci očekávali. To je zásadní známka toho, že trénink v simulovaném prostředí může vyprodukovat AI systémy, které by následně mohly teoreticky fungovat i v reálném světě.

Sami vědci z AI2 říkají, že chápání “agentů”, jak objekty fungují v čase a prostoru ve hře, může být do budoucna pro skutečné roboty užitečné.

V dohledné době však podobné robotické experimenty ve skutečném světě neplánují. “”Agenti” se učí tím, že dělají náhodné věci,” říká Roozbeh Motaghi, vedoucí výzkumu v AI2 a dodává: “Jen si představte ten zmatek, který by mohl způsobit darebácký robot prohánějící se neustále tam a zpátky po laboratoři se záchodovým zvonem.”

Tento článek je chráněn pomocí blockchainové služby Mytitle.